La detención en Paraguay de Hernán Bermúdez Requena, secretario de Seguridad durante el gobierno de Adán Augusto López Hernández en Tabasco; y los avances en las investigaciones por las redes de tráfico de combustible operadas desde el sexenio anterior acrecientan los señalamientos contra una clase política nacional que no atina a esclarecer el escándalo.

Omar García Harfuch, titular de Seguridad y Protección Ciudadana de México, promete “cero tolerancia a la corrupción”, en la instrucción de la presidenta Claudia Sheinbaum, mientras que Inteligencia de Estados Unidos y la FGR adelantan en las pesquisas por el involucramiento de figuras del más alto nivel de la política nacional en la red de corrupción del “huachicol fiscal”.

“Hasta donde tope” irán las indagatorias, ofreció la presidenta de la república, en un momento crucial en su proyecto político y en el rumbo de un país que se extravía.

Inteligencia artificial para todos: ¿Cómo funcionan los modelos que conversan contigo?

TXT Valeria Maeda Gutiérrez y Juan José Oropeza Valdez

La Dra. Maeda-Gutiérrez es Docente-Investigadora en la Unidad Académica de Ingeniería Eléctrica de la Universidad Autónoma de Zacatecas. Su trabajo se centra en el desarrollo y aplicación de modelos de Inteligencia Artificial, Procesamiento de Imágenes y Aprendizaje Profundo en el ámbito biomédico, con énfasis en el estudio de complicaciones microvasculares asociadas a la Diabetes Tipo 2. Es miembro del Sistema Nacional de Investigadoras e Investigadores (SNII) nivel C en el área de Medicina y Ciencias de la Salud.

El Dr. Oropeza-Valdez es Investigador postdoctoral en el Centro de Ciencias de la Complejidad (C3) de la Universidad Nacional Autónoma de México, donde trabaja en el Laboratorio de Biología de Sistemas Humanos. Realiza investigación que utiliza Inteligencia Artificial para analizar la microbiota y datos metabolómicos, con el objetivo de desentrañar las complejas interacciones entre los sistemas del huésped y las comunidades microbianas, desarrollando así estrategias diagnósticas y terapéuticas innovadoras en medicina personalizada.

Esta publicación fue revisada por el comité editorial de la Academia de Ciencias de Morelos.

Introducción

Imagina que estás hablando con alguien que puede explicarte qué es un agujero negro, ayudarte con la tarea de matemáticas o redactar un informe sobre avances en medicina en segundos. No es un genio encerrado en una lámpara, sino un modelo de inteligencia artificial como ChatGPT. Estos modelos funcionan como programas que reciben una entrada (el prompt) y siguen instrucciones aprendidas para producir una salida. Un buen prompt aporta datos, contexto y una pregunta clara. ¿Cómo es posible que una máquina pueda conversar, escribir historias o responder preguntas como si fuera humana? La respuesta está en algo que suena complicado pero que podemos entender juntos: los Modelos Grandes de Lenguaje (en inglés, Large Language Models o LLMs). Estos son modelos matemáticos entrenados que han leído millones de textos y aprendido a imitar cómo hablamos los seres humanos. Aunque carecen de emociones o conciencia, nos sorprenden por su capacidad para generar respuestas coherentes, creativas y a veces hasta científicas. En las siguientes líneas descubrirás con nosotros cómo funciona esta tecnología, que ya utilizas sin darte cuenta: cuando tu teléfono predice qué palabra escribirás en WhatsApp, siempre que Gmail autocompleta tus correos electrónicos, o cuando preguntas algo rápido a asistentes como Siri o Alexa. Entender la Inteligencia Artificial (IA) no es un lujo reservado a especialistas, es una forma de prepararnos para un futuro en donde convivir con estas herramientas será parte de lo cotidiano.

La inteligencia artificial tiene muchas caras

Cuando escuchamos hablar de la IA, lo primero que nos viene a la mente puede ser una máquina, un robot o un programa que traduce idiomas. Todas esas ideas están relacionadas entre sí, pero lo que pocos saben es que la IA no es una tecnología, sino un conjunto de áreas distintas, como caminos que se abren en diferentes direcciones.

Una de las áreas más importantes es el Aprendizaje Automático (en inglés, Machine Learning o ML), que permite a las máquinas (computadoras) aprender a partir de datos. Hay un conjunto de pruebas que se hacen sobre todos los datos hasta que logran encontrar las relaciones o patrones entre estos. Por ejemplo, si un sistema analiza cientos de partidos de fútbol, puede aprender a predecir cuándo un jugador tiene mayor probabilidad de anotar un gol o incluso sugerir estrategias para lograrlo según el comportamiento previo de los equipos. Dentro del Aprendizaje Automático, existe una técnica avanzada llamada Aprendizaje Profundo (en inglés, Deep Learning o DL), que emplea redes de “neuronas artificiales” inspiradas (de forma muy simplificada) en el cerebro humano. Gracias a esto, las máquinas pueden resolver tareas más complejas. Algunas aplicaciones en las que hay mucho interés son la detección de células anormales en estudios médicos o conducir un automóvil sin conductor. Dos aplicaciones muy conocidas del aprendizaje profundo son la Visión por Computadora (en inglés, Computer Vision) y el Procesamiento de Lenguaje Natural (en inglés, Natural Language Processing o NLP). La visión por computadora permite a las máquinas “ver” e interpretar imágenes, como cuando un celular se desbloquea al mostrarle tu rostro o cuando un sistema identifica una fractura usando una radiografía. Por otro lado, el procesamiento de lenguaje natural permite que los programas comprendan lo que decimos o escribimos [1-3]. Esta tecnología está detrás de los traductores automáticos, los asistentes virtuales como Siri o Alexa y también en herramientas como ChatGPT. Cada una de estas áreas cubre una brecha distinta entre lo que los humanos hacemos con naturalidad y lo que las máquinas han aprendido a hacer. Algunas les permiten ver el mundo a través de imágenes, otras escuchar y reconocer sonidos y otras tomar decisiones basadas en datos. Hay un área que destaca porque se enfoca en algo profundamente humano: el lenguaje, nuestra principal forma de pensar, aprender y comunicarnos. Lograr que una máquina entienda nuestras palabras y responda de manera coherente era un sueño de la ciencia ficción hasta hace apenas unas décadas. Hoy, gracias a los modelos grandes de lenguaje, ese sueño se está volviendo realidad, cambiando la manera en que interactuamos con la tecnología: hablamos con asistentes virtuales, obtenemos respuestas rápidas a preguntas complejas e incluso conversamos con sistemas capaces de explicar conceptos científicos en segundos.

¿Qué es un modelo grande de lenguaje?

Son programas de IA diseñados para trabajar exclusivamente con texto. Su función principal parece sencilla: predecir la siguiente palabra en una oración. Sin embargo, para lograrlo, necesitan aprender cantidades enormes de información y emplear técnicas muy avanzadas. Imagina el autocompletado de tu celular: cuando empiezas a escribir un mensaje, te sugiere cuál podría ser la siguiente palabra. Ahora, imagina un sistema que ha “leído” millones de libros, artículos científicos, noticias, conversaciones y páginas web, y que puede usar todo ese conocimiento para continuar la frase de manera coherente, responder preguntas o redactar un texto completo sobre casi cualquier tema. Eso es un LLM: un “superautocompletador” capaz de generar texto con fluidez y naturalidad.

Estos modelos no entienden lo que dicen como lo hacen los humanos. No tienen emociones, opiniones ni conciencia propia, solo procesan texto basándose en probabilidades. Lo que realmente hacen es analizar patrones en miles de millones de palabras, aprendiendo cómo suelen relacionarse entre sí y usando ese conocimiento para construir frases coherentes. Por ejemplo, si les damos la frase: “El fútbol es un deporte muy...", el modelo recuerda haber visto millones de textos en los que después de esas palabras aparecen términos como “popular” o “emocionante”. Calcula cuál de estas palabras tiene mayor probabilidad de aparecer y la elige para continuar la frase. Si le damos un contexto distinto como “El fútbol es un deporte peligroso cuando...", ajustará su predicción para ofrecer una continuación más coherente, como “los jugadores no usan protección adecuada”. La fuerza de estos modelos no está en que comprendan las ideas, sino en que pueden manejar contextos muy amplios al mismo tiempo, encontrando relaciones entre palabras y frases que para nosotros son naturales, pero que para una máquina son solo patrones matemáticos. Gracias a este enfoque, pueden responder preguntas, redactar historias, contar chistes o incluso mantener conversaciones, pero siempre a partir de cálculos estadísticos, no de comprensión real.

Por eso, aunque sus respuestas puedan sonar inteligentes o creativas, un LLM no tiene experiencias propias ni comprende el mundo como nosotros. Todo lo que dice proviene de la información con la que fue entrenado y de las reglas matemáticas que aprendió para ordenar palabras.

¿Cómo aprenden a hablar estas inteligencias artificiales?

Para que un modelo como ChatGPT pueda mantener una conversación, no basta con programarlo palabra por palabra. Necesita aprender de grandes cantidades de información, casi como lo hacemos las personas cuando empezamos a hablar: escuchamos, leemos, practicamos y poco a poco mejoramos nuestra manera de expresarnos. En el caso de las IA, este aprendizaje ocurre en dos etapas principales: el preentrenamiento y el ajuste fino.

El pre-entrenamiento: leer todas las bibliotecas del mundo

En esta primera etapa, los modelos son expuestos a cantidades inmensas de texto; se les alimenta con miles de millones de palabras para que aprendan la estructura del lenguaje, el significado de las palabras según el contexto y cómo suelen relacionarse entre sí. Podemos imaginarlo así: es como un estudiante que pasa años leyendo todo lo que se encuentra en una biblioteca gigantesca, desde cuentos infantiles hasta investigaciones científicas. Con esta lectura masiva, aprende gramática, estilo, expresiones y cómo suelen construirse las ideas en diferentes situaciones. No obstante, en esta fase, el modelo solo aprende patrones generales, sin distinguir qué información es confiable, correcta o apropiada para cada situación [2,4-5].

El ajuste fino: clases particulares para expresarse mejor

Una vez que el modelo ha leído todo lo posible, necesita mejorar su forma de responder. Aquí entra la segunda etapa, conocida como ajuste fino (en inglés, fine-tuning). Durante este proceso, los creadores del modelo le dan ejemplos más precisos y usan retroalimentación humana para enseñarle qué tipo de respuestas son más útiles, claras y seguras. Podría asemejarse a un estudiante que, tras pasar años leyendo por su cuenta, decide asistir a clases particulares con un profesor experimentado. Durante estas sesiones, el profesor revisa cómo responde el estudiante, le señala dónde se equivoca, le enseña a expresarse con mayor claridad y le muestra cómo dar respuestas útiles y respetuosas. Con el tiempo, el estudiante aprende a ordenar mejor sus ideas, a elegir las palabras adecuadas según la situación y a evitar comentarios equivocados o confusos. Del mismo modo, en la etapa de ajuste fino, los modelos reciben ejemplos de cómo responder a distintas preguntas y, gracias a la corrección humana, mejoran su capacidad para mantener conversaciones coherentes y útiles para las personas [2,4-5].

Con estas dos etapas, los modelos grandes de lenguaje logran construir oraciones, mantener conversaciones y adaptarse a distintos temas, desde deportes hasta biomedicina. También desarrollan la capacidad de organizar ideas y responder a las personas. Sin embargo, su desempeño está limitado por los textos con los que fueron entrenados y la calidad de la guía humana recibida durante el ajuste fino. Si la información original es incompleta, contradictoria o contiene errores, el modelo puede repetirlos en sus respuestas. Es como un estudiante que aprende de apuntes equivocados: aunque hable con seguridad, sus explicaciones no siempre serán correctas.

¿Cómo generan texto cuando conversamos con ellas?

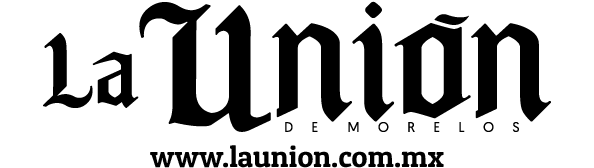

Una vez que los modelos han sido entrenados y han aprendido patrones de lenguaje, llega la parte impresionante: la generación de texto en tiempo real. Cada vez que escribimos una pregunta o iniciamos una conversación con ChatGPT, el modelo no busca una respuesta almacenada ni copia un párrafo exacto de algún libro. Lo que hace es predecir palabra por palabra cuál es la continuación más probable, basándose en todo lo que aprendió. Este proceso se llama funcionamiento autorregresivo, y se parece a cuando una persona improvisa una respuesta. Por ejemplo, cuando te hacen una pregunta inesperada, no tienes toda la respuesta lista en tu mente. Más bien, vas construyendo tu respuesta palabra por palabra según recuerdas información relevante. De manera similar, estos modelos improvisan sus respuestas a partir de los patrones aprendidos, palabra por palabra, en tiempo real. La gran diferencia es que en un modelo como ChatGPT no solo tiene en cuenta las últimas dos o tres palabras, sino todo el contexto de la conversación, pudiendo analizar frases largas, ideas previas y la estructura completa de lo que estás preguntando. Esto le permite generar textos adaptados a tu solicitud. Supongamos que escribes: “El corazón humano es un órgano que…”, el modelo calcula qué palabra podría aparecer a continuación basándose en todas las veces que ha visto oraciones similares durante su entrenamiento. Podría continuar con “bombea”, “late” o “impulsa sangre”, eligiendo aquella opción que tiene mayor probabilidad de encajar con el resto de la frase. Después de esa palabra, vuelve a calcular cuál es la siguiente palabra más probable y así sucesivamente, hasta completar la respuesta. Cabe resaltar que todo esto ocurre en milésimas de segundo. Este mecanismo es tan rápido y preciso que parece que el modelo “piensa” en lo que dice, pero en realidad solo está siguiendo un cálculo estadístico muy sofisticado. No tiene un plan previo ni una idea clara de toda la respuesta desde el inicio: simplemente va construyendo el texto paso a paso, evaluando cada posible palabra y escogiendo la que mejor se ajusta al contexto y al estilo de la conversación. Para hacer posible este proceso, el modelo utiliza cientos de miles de millones de parámetros (por ejemplo, ≈175 mil millones en GPT-3), que funcionan como pequeñas conexiones internas en una red enorme, cada una influyendo en cómo las palabras se relacionan entre sí. Durante el entrenamiento, estas conexiones se ajustaron millones de veces hasta encontrar la combinación que permite generar textos comprensibles y naturales. Podríamos decir que, cuando conversamos con él, el modelo activa esas conexiones y las coordina para formar respuestas sin necesidad de memorizar frases exactas. Por ejemplo, el modelo podría funcionar como un médico virtual, que ha leído millones de libros de medicina, artículos científicos y reportes clínicos. Cuando le preguntas algo, no busca una respuesta almacenada, sino que va construyendo la frase palabra por palabra (Figura 1), asignando distintas probabilidades a las posibles continuaciones de la oración. Si le preguntas: “¿Cuál es la función del corazón humano?”, el sistema puede responder “bombea sangre para llevar oxígeno a todo el cuerpo”, seleccionando cada palabra según su probabilidad condicional dada el contexto, no porque 'quiera' lograr una explicación clara. Así funcionan los modelos grandes de lenguaje: no repiten textos, lo que realizan son cálculos en tiempo real para dar la respuesta más probable [1,4-5].

Figura 1. Funcionamiento básico de un Modelo Grande de Lenguaje (LLM). A partir de una frase incompleta (“El corazón humano es un órgano que …”), el modelo calcula la probabilidad de varias continuaciones. La barra azul representa la opción más probable (“bombea sangre”), seguida de otras alternativas (“late”, “regula”, etc.). La salida no es una idea “comprendida”, sino una distribución de probabilidades sobre palabras que podrían completar el enunciado.

Usos cotidianos

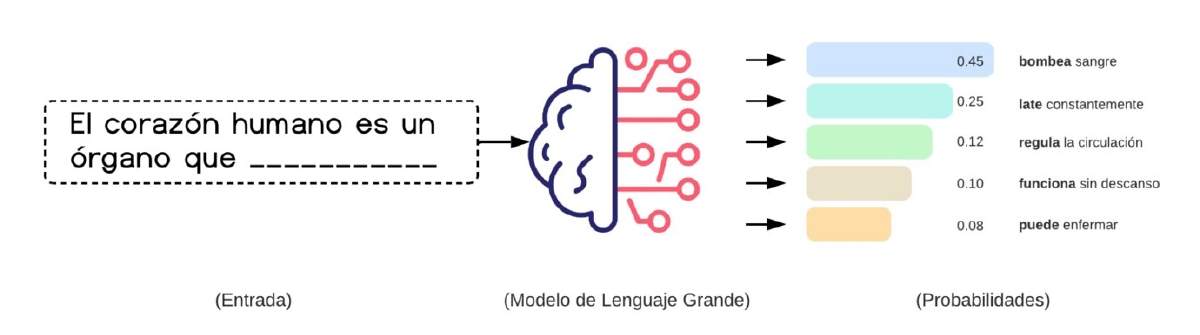

Aunque parezca una tecnología muy reciente, la realidad es que estos sistemas están presentes en distintas actividades y campos, ayudando a personas de todas las edades. En las compras en línea, los modelos pueden ayudarte a comprar productos, recomendarte opciones según tus gustos o redactar mensajes para vendedores. En la cocina, proponen recetas usando los ingredientes que tienes a mano, ajustan platillos para hacerlos más saludables o convierten medidas y proporciones al instante mientras preparas tus alimentos. Durante un viaje, sirven para planear itinerarios, buscar actividades en un destino turístico, traducir frases a otro idioma o incluso escribir mensajes para comunicarte mejor en el extranjero. En la organización diaria, son útiles para elaborar listas de compras, programar recordatorios, redactar felicitaciones personalizadas o incluso escribir invitaciones y mensajes para eventos familiares. En el ámbito de la creatividad digital, son útiles no solo para escribir publicaciones en redes sociales, sino también para generar descripciones de fotografías. En un ejemplo de cómo funciona esto (Figura 2), la fotografía de interés se ingresa a una red neuronal, que analiza la imagen y asigna la mayor probabilidad a la clase ‘Gato’ o al objeto que desees analizar. También son aliados en la educación, explicando temas difíciles en palabras sencillas, ofreciendo ejemplos adicionales para entender una lección o generando cuestionarios y resúmenes para estudiar. Y, por supuesto, contribuyen al entretenimiento, sirviendo para crear historias interactivas, diálogos para videojuegos o guiones para podcasts y videos. Incluso pueden ayudarte a componer canciones o inventar cuentos para niños, adaptando el estilo y el tono a lo que pidas [3]. Estos ejemplos muestran cómo esta tecnología, que parecía exclusiva de laboratorios y expertos en informática, ya es parte de nuestras actividades diarias, transformando la manera en que estudiamos, trabajamos y nos comunicamos.

Figura 2. Clasificación de imágenes mediante una red neuronal de visión por computadora. La fotografía de un gato pasa por una red neuronal convolucional que genera probabilidades para cada clase (“Perro”, “Gato”, “Pájaro”). Se incluye, a modo de referencia de escala, el número aproximado de parámetros que emplea GPT-3 (≈175 mil millones) y el número de neuronas de un cerebro humano (≈86 mil millones).

Limitaciones y precauciones

A pesar de sus sorprendentes capacidades, los modelos grandes de lenguaje no son perfectos ni infalibles. Aunque pueden dar la impresión de “saberlo todo”, es importante recordar que no tienen emociones, conciencia ni comprensión real de lo que dicen. Solo repiten patrones aprendidos a partir de los textos con los que fueron entrenados. Una de sus principales limitaciones son las llamadas “alucinaciones”, que ocurren cuando el modelo inventa información que suena coherente pero no es verdadera. Por ejemplo, puede citar un dato inexistente, inventar una referencia científica o mezclar hechos reales con otros completamente falsos. Otra limitación son los sesgos en los datos de entrenamiento. Si los textos con los que aprendió contenían prejuicios, estereotipos o información poco equilibrada, es posible que el modelo refleje esos mismos problemas en sus respuestas. Además, no pueden verificar información en tiempo real, ya que no están conectados permanentemente a bases de datos actualizadas. Tampoco pueden sustituir el juicio humano, especialmente en áreas sensibles como la medicina, el derecho o la toma de decisiones críticas. Por estas razones, se recomienda usar estas herramientas como apoyo, para obtener ideas, aclarar conceptos o redactar textos más rápido, pero nunca como una fuente única o infalible de información. La supervisión humana, la verificación de datos y el pensamiento crítico siguen siendo esenciales cuando utilizamos la IA [5].

Conclusión

La llegada de los modelos grandes de lenguaje marca un punto de inflexión en nuestra relación con la tecnología. Por primera vez, podemos interactuar con sistemas que generan texto de forma tan natural que parecen comprendernos. Esto abre la puerta a nuevas formas de aprender, comunicarnos y crear contenido, acercando el conocimiento y la información a más personas en cuestión de segundos. Pero más allá de la fascinación inicial, este avance nos invita a reflexionar sobre cómo queremos convivir con estas herramientas. Su uso responsable y ético será clave para evitar que la información errónea se propague, que los sesgos se amplifiquen o que dependamos demasiado de las respuestas automáticas. La IA no reemplaza nuestra capacidad de pensar, analizar y decidir; al contrario, nos reta a fortalecerla para aprovechar al máximo una tecnología que, bien utilizada, puede convertirse en una poderosa aliada para el futuro.

Referencias

[1] Tan, X., G. Cheng, and M. H. Ling. (2025). "Artificial intelligence in teaching and teacher professional development: A systematic review." Computers and Education: Artificial Intelligence, 8: 100355. doi: 10.1016/j.caeai.2024.100355

[2] Stöffelbauer, A. “How Large Language Models Work”. Medium. Consultado el 31 de julio de 2025. [En línea]. Disponible en: https://medium.com/data-science-at-microsoft/how-large-language-models-work-91c362f5b78f.

[3] Kühl, N., M. Schemmer, M. Goutier, and G. Satzger. (2022). "Artificial intelligence and machine learning." Electronic Markets, 32(4):2235–2244. doi: 10.1007/s12525-022-00598-0

[4] Kasneci, E., K. Sessler, S. Küchemann y col. (2023). "ChatGPT for good? On opportunities and challenges of large language models for education." Learning and Individual Differences, 103: 102274. doi: 10.1016/j.lindif.2023.102274

[5] Zhao, W. X., K. Zhou, J. Li, T. Tang, y col. (2025). "A survey of large language models." https://doi.org/10.48550/arXiv.2303.18223

Esta columna se prepara y edita semana con semana, en conjunto con investigadores morelenses convencidos del valor del conocimiento científico para el desarrollo social y económico de Morelos.

Adrián Marcelo habla sobre las críticas tras 'La Casa de los Famosos México' y el impacto emocional que dejó

TXT Sara Pacheco

Desde su participación en la segunda temporada de “La Casa de los Famosos México” en 2024, el youtuber regiomontano Adrián Marcelo se ha mantenido en el ojo público.

Su paso por el reality le otorgó gran visibilidad, pero también lo convirtió en blanco de duras críticas en redes sociales.

Recientemente, Adrián Marcelo se abrió sobre esta experiencia en el podcast “Creativo”, conducido por Roberto Martínez, donde reconoció que la magnitud de las reacciones del público le dejó una herida emocional difícil de sobrellevar.

El creador de contenido señaló que, a pesar de su carácter fuerte y su preparación para enfrentar los retos del programa, el juicio público que recibió fue desproporcionado y lo afectó personalmente.

Explicó que lo más complicado fue lidiar con la sensación de haber sido objeto de un escarnio constante, lo que incluso llegó a afectar su capacidad de disfrutar la vida cotidiana.

Marcelo también admitió haber sentido cierto resentimiento hacia la percepción que tuvo la audiencia, aunque matizó que no se trata de un enojo contra el país, sino contra la presión colectiva que se genera en redes sociales.

Destacó que, a pesar de las críticas, no se ve a sí mismo como víctima, sino como alguien que ha aprendido a lidiar con la fama y las controversias.

A pesar del escrutinio, su participación en el reality consolidó su presencia como figura polémica pero influyente en internet, generando tanto seguidores leales como detractores férreos.

Fátima Bosch, Miss Universe México 2025, revela tensiones tras su coronación: 'Solo cuatro compañeras me felicitaron'

TXT Sara Pacheco

El Conjunto Santander de Zapopan, Jalisco, fue el escenario de la final de Miss Universe México 2025, donde Fátima Bosch, representante de Tabasco, se coronó como la nueva reina nacional.

La joven tabasqueña será la encargada de representar a México en la próxima edición de Miss Universe, que se celebrará el 21 de noviembre en Bangkok, Tailandia.

Visiblemente emocionada, Bosch recordó el momento en que escuchó su nombre como ganadora y señaló que pensó de inmediato en su preparación para la competencia internacional. Destacó la disciplina, constancia y resiliencia que le dejó su participación en el certamen, así como el apoyo de la organización.

Sin embargo, la celebración no estuvo exenta de polémica. La nueva soberana nacional reveló que solo cuatro compañeras se acercaron a felicitarla tras recibir la corona: Elena (Tlaxcala), Lorena (Tamaulipas), Emiré (Yucatán) y Fernanda Puma (Veracruz).

“Creo que la sororidad verdadera no se dice solo de dientes para afuera, se aplica. Hoy tristemente no se dio en este caso”, señaló Bosch, quien añadió que más allá de los discursos, la solidaridad entre participantes debe reflejarse en acciones concretas.

A pesar de la tensión, Fátima Bosch aseguró que su enfoque está en la competencia internacional y en representar a México con orgullo. “Es un orgullo representar lo que es México en el mundo. Voy a trabajar muchísimo para dejar a nuestro país en alto”, afirmó.

Respecto a su victoria, la reina de belleza destacó con humildad que todas sus compañeras poseen cualidades y virtudes, y que su triunfo se debió a factores de la vida y el destino.

@gabrielalaociosa Recién elegida como Miss Universe México 2025, Fátima Bosch de Tabasco, habló por primera vez de la controversia y falta de apoyo de algunas compañeras #missuniverse #guadalajara #corona #controversia @Publimetro México 🌐 ♬ sonido original - Gabriela La Ociosa

El triunfo de Bosch y sus declaraciones sobre la falta de felicitaciones han puesto nuevamente en el centro de atención a la convivencia y sororidad dentro de los certámenes de belleza, al tiempo que la joven tabasqueña se prepara para dejar en alto el nombre de México en Bangkok.

Cazzu celebra el segundo cumpleaños de su hija Inti con una lujosa fiesta temática

TXT Alicia Velasco

Este domingo 14 de septiembre, Cazzu organizó un festejo especial por el segundo cumpleaños de su hija Inti, fruto de su relación con Christian Nodal.

La trapera argentina compartió en sus redes sociales fotos del evento, mostrando una decoración inspirada en un jardín, con ranas, hongos y elementos de la naturaleza como protagonistas.

Madre e hija coordinaron sus outfits, luciendo pantalón y camisa de cuadros blancos y verdes, mientras Inti llevaba dos coletas.

En las imágenes también se aprecia un pastel con una rana sobre un hongo, mesas con mini hamburguesas, empanadas y vasos temáticos para los invitados, aunque aún no se confirma quiénes asistieron ni la presencia de Christian Nodal.

El festejo llega en un momento de tensión entre Cazzu y Nodal, ya que la cantante ha señalado al músico de ser un padre ausente y de limitar algunos permisos para viajar con la menor, necesarios para su carrera artística.

La celebración se da apenas horas después del regreso de Cazzu a los escenarios.

La noche del 13 de septiembre ofreció el primer concierto de su gira Latinaje en el Movistar Arena de Buenos Aires, donde interpretó su éxito Con Otra, un tema estrenado tras el anuncio de que Nodal contrajo matrimonio con Ángela Aguilar.

Los fans sorprendieron a la artista con carteles de apoyo y empoderamiento que destacaban su valentía y talento.

Hoy, 14 de septiembre, Cazzu continuará los festejos ofreciendo su segundo concierto en Buenos Aires, antes de viajar a Uruguay y México para continuar con su gira, cuyas fechas en el país están agotadas.

Microsoft 365 tendrá versiones más baratas en todo el mundo tras presión de la Comisión Europea

TXT Javier Marquez

Microsoft reducirá los precios de suscripciones de Office 365 y Microsoft 365 sin Teams a partir de noviembre, en un movimiento que marca un precedente en la regulación del mercado digital.

El cambio no es una promoción comercial, sino el resultado de un acuerdo con la Comisión Europea, que investigaba a la compañía por presuntas prácticas antimonopolio desde 2020.

El origen del caso se remonta a la denuncia de Slack, que acusó a Microsoft de empaquetar Teams dentro de Office, dificultando la elección de herramientas rivales. Tras una investigación formal, Bruselas consideró que esta integración podía suponer un abuso de posición dominante.

Para evitar sanciones millonarias, la compañía aceptó separar Teams de sus suites de productividad y garantizar precios más bajos para quienes elijan versiones sin esta aplicación.

Cambios clave en Microsoft 365

-

Desde noviembre habrá ediciones “sin Teams” con precios más bajos:

-

Los compromisos estarán vigentes al menos siete años, con medidas de interoperabilidad y portabilidad de datos aplicables durante una década.

-

Las empresas podrán migrar a planes sin Teams sin penalizaciones, aunque deberán hacerlo al renovar sus suscripciones.

-

Los usuarios domésticos y estudiantes no tendrán cambios, ya que sus planes no incluían Teams de pago.

Además, Microsoft se compromete a abrir su ecosistema, permitiendo que servicios competidores integren aplicaciones de Office en sus plataformas y que los usuarios puedan exportar datos de Teams a otras herramientas, reduciendo así barreras de cambio.

Impacto global y contexto político

Aunque el caso comenzó en Europa, Microsoft aplicará los cambios en todo el mundo. Esto no solo beneficia a empresas multinacionales, sino que también envía una señal sobre cómo la presión regulatoria puede modificar las estrategias de gigantes tecnológicos.

La Comisión Europea refuerza así su papel como regulador digital, en un momento en que mantiene investigaciones y sanciones contra otras compañías, como Google. Sin embargo, la medida también abre un frente diplomático, pues el presidente de Estados Unidos, Donald Trump, ha criticado estas decisiones y amenazado con represalias comerciales bajo la Sección 301 de la Ley de Comercio.

Xbox Game Pass confirma seis estrenos para octubre, incluido Ninja Gaiden 4

TXT Javier Salcedo

Octubre será un mes fuerte para los suscriptores de Xbox Game Pass y PC Game Pass, ya que Microsoft y diversos estudios confirmaron una primera lista de seis títulos que se incorporarán al servicio.

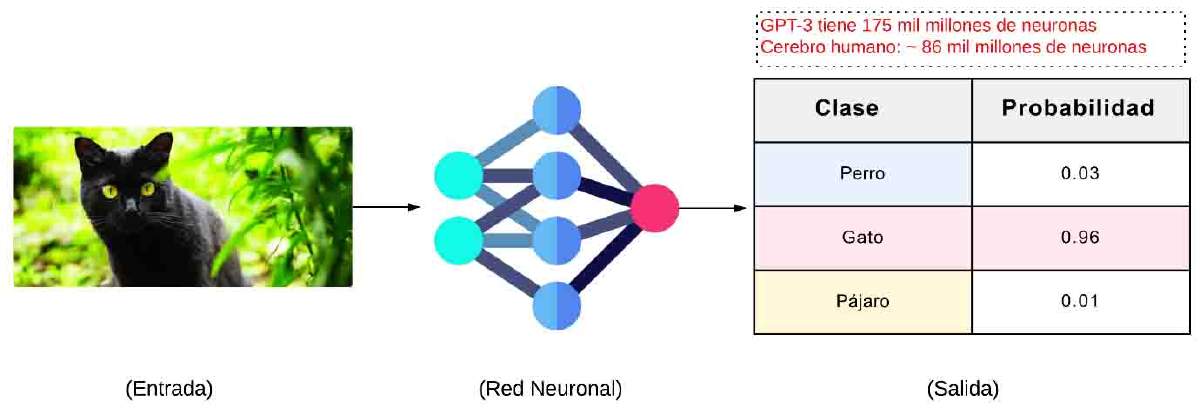

Entre ellos destacan producciones de alto perfil como Ninja Gaiden 4 y The Outer Worlds 2, además de propuestas independientes con mecánicas originales.

Estos lanzamientos representan estrenos de día 1 dentro del servicio, lo que significa que los usuarios podrán jugarlos sin costo adicional desde el primer día de su salida.

De esta forma, la plataforma continúa consolidando su catálogo con títulos de acción, RPGs y experiencias creativas que buscan atraer a todo tipo de jugadores.

Juegos confirmados para octubre en Xbox Game Pass

-

15 de octubre: Ball x Pit (Devolver Digital, roguelite de supervivencia y construcción).

-

17 de octubre: Keeper (Double Fine, aventura en la que el protagonista es un faro).

-

21 de octubre: Ninja Gaiden 4 (Team Ninja y Platinum Games, acción frenética con Yakumo como protagonista).

-

23 de octubre: Bounty Star (acción 3D con mechas y construcción de bases).

-

23 de octubre: Moonlighter 2 (PC Game Pass, secuela del exitoso indie de gestión y mazmorras).

-

29 de octubre: The Outer Worlds 2 (Obsidian Entertainment, RPG de ciencia ficción).

Debate en México por posible alza de precios

Mientras tanto, en México sigue el debate sobre la propuesta de un impuesto del 8% a los juegos violentos, que podría impactar no solo en títulos individuales, sino también en servicios de suscripción como Xbox Game Pass, PlayStation Plus y otros.

Si las empresas no detallan qué porcentaje de su catálogo incluye este tipo de juegos, la ley asumiría que es el 70%, aplicando automáticamente el impuesto sobre ese valor.

La medida aún está en revisión en el Senado y la Cámara de Diputados, y se espera que hacia finales de octubre se determine si se aprueba o si sufre modificaciones.

Con estrenos esperados y un posible ajuste de precios en el horizonte, octubre será clave para los usuarios de Xbox Game Pass en México y el resto del mundo.

Jojo’s Bizarre Adventure: Steel Ball Run confirma ventana de estreno en Netflix

TXT Ulises Contreras

La esperada adaptación animada de Jojo’s Bizarre Adventure: Steel Ball Run, considerada por muchos como la mejor parte del manga creado por Hirohiko Araki, ya tiene ventana de lanzamiento.

La serie producida por David Productions se estrenará en exclusiva en Netflix en 2026, aunque aún no se ha revelado la fecha exacta.

El anuncio llega tras meses de rumores y especulaciones. Incluso, el director de sonido Yoshikazu Iwanami comentó en agosto de 2025 que apenas habían terminado el trabajo sonoro del primer episodio, lo que anticipaba un estreno todavía lejano.

Para despejar dudas, la producción celebrará un evento especial el 23 de septiembre, donde se espera que se confirmen la fecha definitiva, el reparto de voces y nuevos avances.

Here's the Teaser Art for STEEL BALL RUN JoJo's Bizarre Adventure, based on the manga by Hirohiko Araki!

— Netflix Anime (@NetflixAnime) September 12, 2025

Coming soon, only on Netflix! pic.twitter.com/Oz7VAN0JxB

Expectativa y polémica entre los fans

La emoción es alta, pues la historia de Johnny Joestar y Gyro Zeppeli es uno de los arcos más populares de la saga.

Sin embargo, también surgieron preocupaciones. La comunidad teme que Netflix repita la estrategia usada en Stone Ocean, donde los episodios se lanzaron en tandas en lugar de semanalmente, lo que, según los seguidores, redujo el impacto del estreno y apagó el entusiasmo colectivo.

El nuevo adelanto oficial no trajo imágenes inéditas —ya se había mostrado en la primavera de 2025—, lo que generó cierta decepción entre los fans. Aun así, la confirmación de la ventana de estreno mantiene viva la expectativa por una de las entregas más queridas de la franquicia.

¿Cuántos episodios tendrá?

La duración del anime aún es un misterio. No obstante, considerando que el arco de Steel Ball Run abarca los capítulos 753 al 847 del manga, se estima que la adaptación podría contar con entre 30 y 40 episodios, en línea con lo que ocurrió con Stone Ocean, que tuvo 38 capítulos.

Con esto, Jojo’s Bizarre Adventure se prepara para dar un nuevo salto en la pantalla, llevando a Netflix una de las sagas más aclamadas por el público en Japón, México y gran parte de Occidente.

Netflix confirma estreno de la Temporada 4 de The Witcher con Liam Hemsworth

TXT Mardokeo Galván

La espera terminó para los seguidores de The Witcher.

Netflix reveló un nuevo tráiler de la cuarta temporada de la serie live-action, donde por primera vez se puede ver de forma más amplia a Liam Hemsworth en el papel de Geralt de Rivia.

El adelanto, mostrado durante la pelea Canelo vs. Crawford, ofrece un vistazo al brujo enfrentándose a un espíritu maligno y marca el inicio de una nueva etapa en la historia tras la salida de Henry Cavill.

Aunque ya se había compartido un breve avance en 2024, esta es la primera ocasión en la que el actor australiano se muestra en acción como protagonista.

La compañía confirmó además la fecha de estreno: la Temporada 4 llegará el 30 de octubre de 2025, cumpliendo con el ciclo de producción de dos años al que la serie ha estado acostumbrando a sus fanáticos.

For Geralt, Ciri and Yennefer, the war never ends.

— Netflix UK & Ireland (@NetflixUK) September 14, 2025

THE WITCHER S4 arrives on Netflix 30 October. pic.twitter.com/T8bdqYYQtT

La showrunner Lauren Schmidt Hissrich adelantó que esta será la penúltima temporada y que servirá como el inicio de un arco de dos entregas que llevarán a los personajes a una conclusión definitiva.

“No sería The Witcher si todo terminara felizmente. Éste es el comienzo de un viaje de dos temporadas para que nuestra familia finalmente se reúna”, señaló.

Con esta confirmación, los seguidores podrán prepararse para la recta final de una de las adaptaciones de fantasía más populares de la plataforma.

Firefox se prepara para integrar Google Lens y un asistente de IA en su navegador

TXT Europa Press

Mozilla trabaja en nuevas funciones para Firefox, entre ellas la integración de Google Lens y un asistente de inteligencia artificial propio, con el objetivo de mejorar la experiencia de navegación.

La primera novedad permitirá realizar búsquedas visuales con Google Lens directamente desde el navegador, aunque solo funcionará con imágenes en formatos compatibles.

Esta opción aparecerá en el menú contextual de Firefox con la etiqueta “Nuevo” y redirigirá a una URL especial de búsqueda visual.

De acuerdo con el portal especializado omgubuntu, esta característica ya comenzó a mostrarse a algunos usuarios como parte de la preparación para el lanzamiento de la versión 143 de Firefox, prevista para la próxima semana.

Además, Mozilla también desarrolla un proyecto más experimental: un asistente de página basado en IA, conocido provisionalmente como “Page Buddy”. Este chatbot permitirá a los usuarios realizar preguntas sobre el contenido de la página web que estén visitando, ofreciendo un apoyo más interactivo durante la navegación.

Por ahora, la herramienta está en fase temprana dentro de Firefox Nightly y se espera que funcione con un modelo offline, lo que implicaría un mayor nivel de privacidad para los usuarios.

Con estas innovaciones, Firefox busca mantenerse competitivo frente a otros navegadores al combinar funciones de búsqueda más inteligentes con el potencial de la inteligencia artificial.